[TOC]

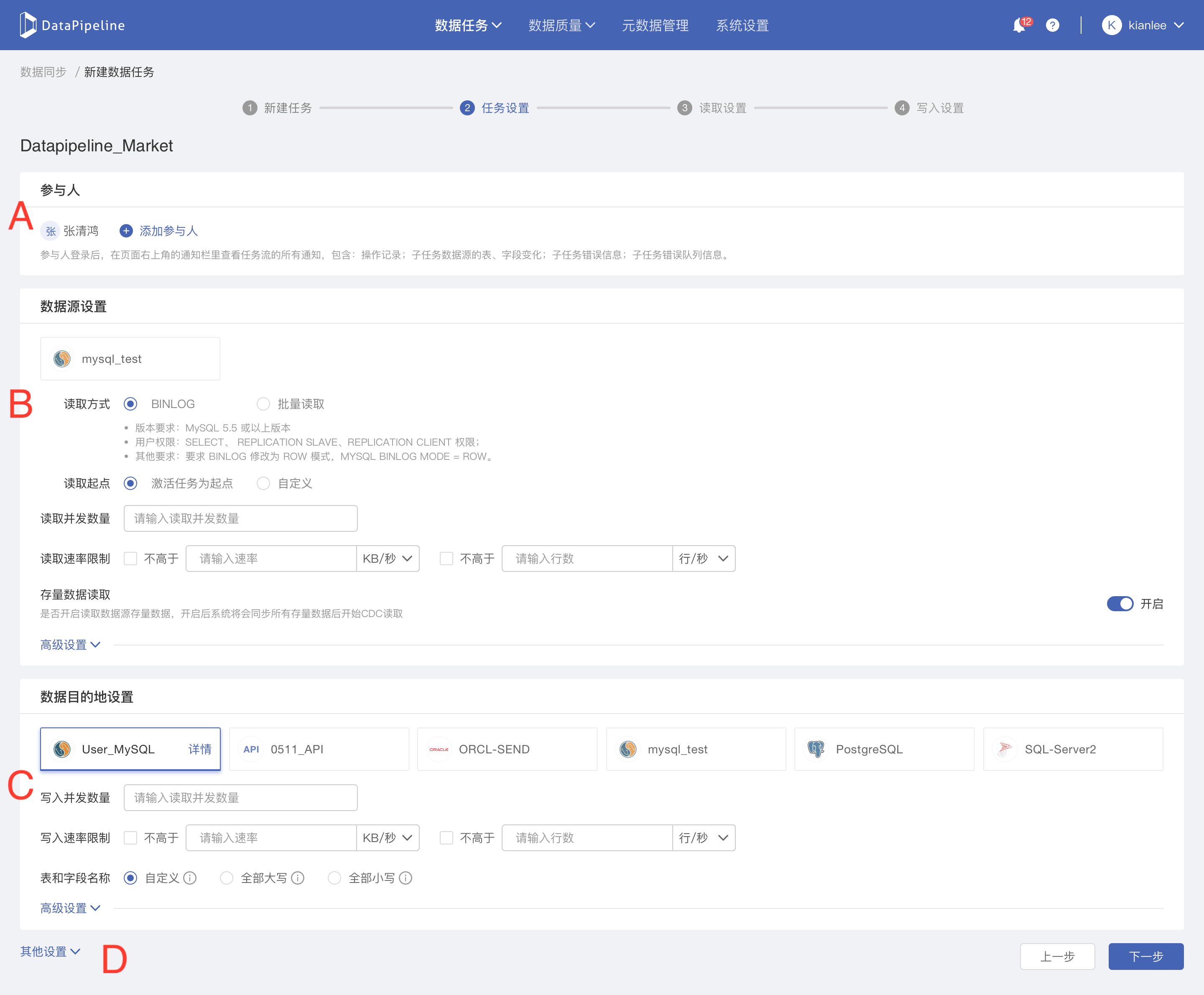

# 任务设置

## 1.什么是「任务设置」?

在创建数据任务第二步中,用户已经对任务进行个性化的配置。在这个页面,用户可以在任务激活前后对一些通用配置进行灵活修改,实时调配任务的资源,设定通知等相关内容。

## 2.主要设置内容介绍

### A. 「参与人」设置

* 「参与人」拥有该任务的浏览和编辑权限,并且会在通知中心收到该数据任务的所有通知,包含:

* 操作记录;

* 数据任务错误信息;

* 错误队列信息。

* 默认只显示该数据任务创建人,并且不允许删除。

* 点击「+」按钮,将显示下拉框进行参与人选择。

* 支持单选或多选参与人或勾选用户组选择整个用户组的用户作为参与人;

* 再次点击取消选择;

* 支持搜索用户名称,直接在输入框输入用户名关键词即可,区分大小写。

:-:

* 参与人列表中,鼠标移动到参与人上,将显示「×」按钮,点击后将删除该参与人。

:-:

* 只有创建者和管理员能够删除任务。

### B.「数据源设置」

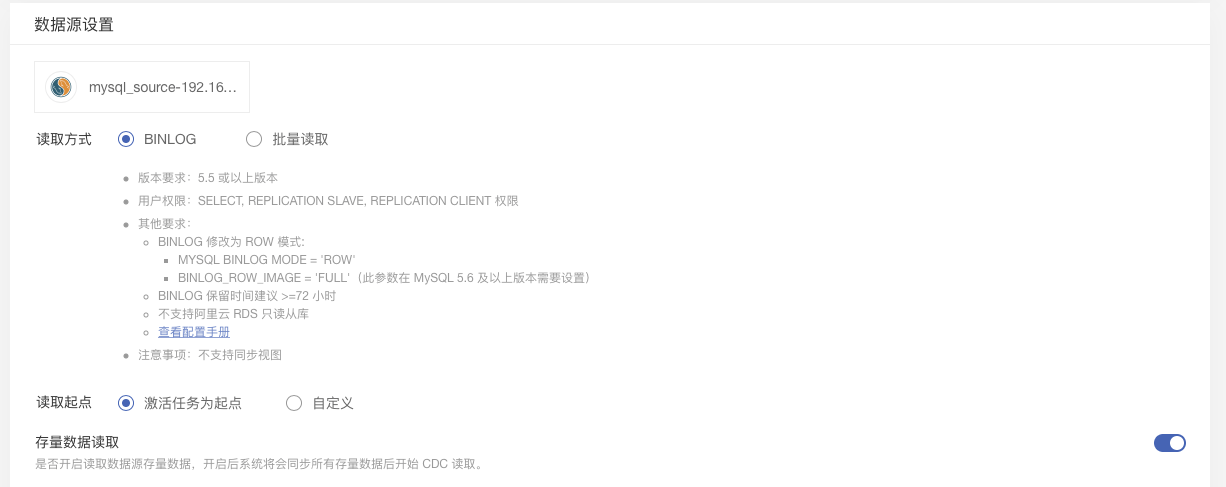

#### 「读取方式」

读取方式:可选择实时模式或批量读取,默认勾选各个数据源的实时模式。

MySQL为Binlog、Oracle为Logminer、SQL Server为Change Tracking、Postgre SQL为wal2json或者decoderbufs

* **实时模式**读取方式下会进行实时同步,用户可以选择读取起点和是否开启存量读取。

* *读取起点*,用户可以选择从哪里开始读取数据,两个选项:激活任务为起点(默认)、自定义。

* 激活任务为起点,代表任务激活后系统将开始数据同步。

* 选择自定义,用户需要自定义设置读取的起始位置。

* 数据源为MySQL,需要输入Binlog Postion(必填)、Binlog文件名称(必填)、GTID(选填)

* 数据源为Oracle,需要输入「LogMiner scn 」(必填)

* 数据源为SQL Server,需要输入Change tracking version (必填)

* 数据源为PostgreSQL,需要输入lsn (必填)

* *存量数据读取*

* 开启后系统会先读取存量再读取增量;

* 关闭后系统不会去存量而是会直接去读增量数据。

* **批量读取**方式下会定时同步数据,需要设置读取频率,两个选项(单选):同步一次,定时读取

* 默认选择「定时读取」。选择定时读取后,要求用户输入读取频率,默认为 60秒,允许使用Cron表达式。

* 也可选择「同步一次」。表示该任务只同步一次数据源数据到目的地即可。(数据源为MySQL、Oracle、SQL Server、Postgre SQL 允许只同步一次)

* 当数据源为Oracle、SQL Server时,LogMiner和Change Tracking实时读取模式会采用定时查询方式读取增量,所以需要用户去设置一定的读取频率,用户设置读取频率越大相对来说数据延迟性也就越大,但读取频率过小时,会对系统造成一定的压力,因此,需要用户根据实际情况设置相对合理的读取频率,目前DataPipeline会默认读取频率为60秒。

<br/>

#### 「读取并发数量」

读取并发数量(支持 MySQL、Oracle、SQL Server 、PostgreSQL、Kafka、API、Hive数据源)

* 读取并发数量是指该任务从数据源中并行读取表的数量,默认为5。

* 具体读取并发数量要根据数据源可接受请求量决定。

* 并发数量代表着每次读取的表的数量,当表读取完毕时系统会释放掉该线程,其他的表可继续抢占该线程进程数据的读取。任务暂停后又重启所有的表会重新抢占线程,系统会按照断点续传的方式继续同步新增数据。

<br/>

#### 「读取速率限制」

* 当用户设置读取速率限制,系统平均读取速率将不会超过该数值。

* 可按流量或行数作为限制条件。

* 用户能够不选、单选或多选,若同时勾选,两种限制将同时应用。

* 勾选后即可激活对应的速率限制,请输入正整数;

* 支持两种速率限制:速率流量限制、速率行数限制;

* 流量限制:限制读取的最高流量速率;

* 默认单位为:KB/秒;

* 点击下拉框可切换单位:MB/秒。

* 行数限制:限制读取的最高行数速率;

* 默认单位:行/秒。

:-:

<br/>

#### 「高级设置」

* 传输队列最大缓存值

* 任务开始读取数据后,单个任务默认缓存10GB数据(读写数据量差),用户可自定义。

* 读写数据量差达到10GB(最大缓存值时),根据先进先出的原则,旧数据将会被回收。

* 当任务数据读写速率失衡,读写数据量差大于10GB(最大缓存值)时,将会出现部分数据被回收,未能成功写入数据目的地的情况。

* 传输队列回收时间

* 任务开始读取数据后,单个任务默认缓存3天数据,用户可自定义。

* 缓存数据达到回收时间,旧数据将会被回收。

* 当任务数据读写速率失衡,超过回收时间的数据尚未被写入到目的地,将会出现部分数据被回收,未能成功写入数据目的地的情况。

* 数据任务动态限速

* 开启后该数据任务读写数据量差达到「最大缓存值」,任务将会暂停数据读取工作。当实际缓存数据量小于「最大缓存值」时会重新开始读取数据。

* 可根据用户情况自定义「检查频率」

* 读取端事务一致性

* 用户「关闭」该选项,DataPipeline 从数据源读取数据后,将会立即写入到目的地。

* 用户「开启」该选项,DataPipeline 从数据源读取数据后,系统定期记录读取的进度,数据对应的进度被成功记录了,才会被允许写入到目的地。以此来保证系统出现重启或者rebalance的情况时,根据系统明确的标记信息来保证目的地数据的一致性。

:-:

### C. 「数据目的地设置」

#### 「写入并发数量」

* 写入并发数是指系统一次性写入表的数量,并发数量代表着每次写入的表的数量,当表写入完毕时系统会释放掉该线程,其他的表可继续抢占该线程进程数据的写入。

* 决定该任务的写入并发数,即同时写入数据表的数;

* 请输入正整数。

<br/>

#### 「写入速率限制」

* 写入速率限制是指系统限制每次写入表的最大流量和每秒写入的最大行数,当设置了写入表的最大流量时,则系统会限制写入表的流量低于用户设置的最大流量数;当设置了每秒写入的最大行数时,则系统限制每秒所写入的行数低于用户设置的最大行数。

* 支持两种速率限制:速率流量限制、速率行数限制;

* 流量限制:限制写入的最高流量速率;

* 默认单位为:KB/秒;

* 点击下拉框可切换单位:MB/秒。

* 行数限制:限制写入的最高行数速率;

* 默认单位:行/秒。

* 用户能够不选、单选或多选,若同时勾选,两种限制将同时应用。

* 勾选后即可激活对应的速率限制,请输入正整数;

<br/>

#### 「表和字段名称」

(目的地为Kafka时改为Topic和字段名称,FTP时改为文件名和字段名称)

* SQL类型数据源、FTP和S3静态支持设置目的地大小写; FTP和S3动态、API数据源是暂不支持设置目的地大小写;Hive和Redshift目的地也不支持设置目的地大小写。

* 支持用户设置目的地表名称和字段名称大小写

* 选项:自定义(默认)、全部大写、全部小写

* 鼠标浮在每个选项上提示用户

* 选择【自定义】,任务执行后,系统会根据用户自定义的表和字段名称写入到目的地。

* 选择【全部大写】,任务执行后,系统会将用户设置的所有表和字段名称转换为大写(只包含英文)后写入到目的地。

* 选择【全部小写】,任务执行后,系统会将用户设置的所有表和字段名称转换为小写(只包含英文)后写入到目的地。

:-:

<br/>

#### 「每次定时执行批量同步前,允许清除目标表数据」

* 数据源为SQL、API,数据目的地为SQL、Hive、TIDB、Redshift、Greenplum时,读取方式为批量定时读取时,显示该项。

* 点击开启,则每次定时批量读取时,系统都会先清除目标表的数据再进行写入

* 点击关闭,则每次定时批量读取时,系统不会清除目标表的数据会直接把每次批量的数据写入到目的地,系统会根据主键和增量识别字段来进行去重操作。

#### 「高级设置」

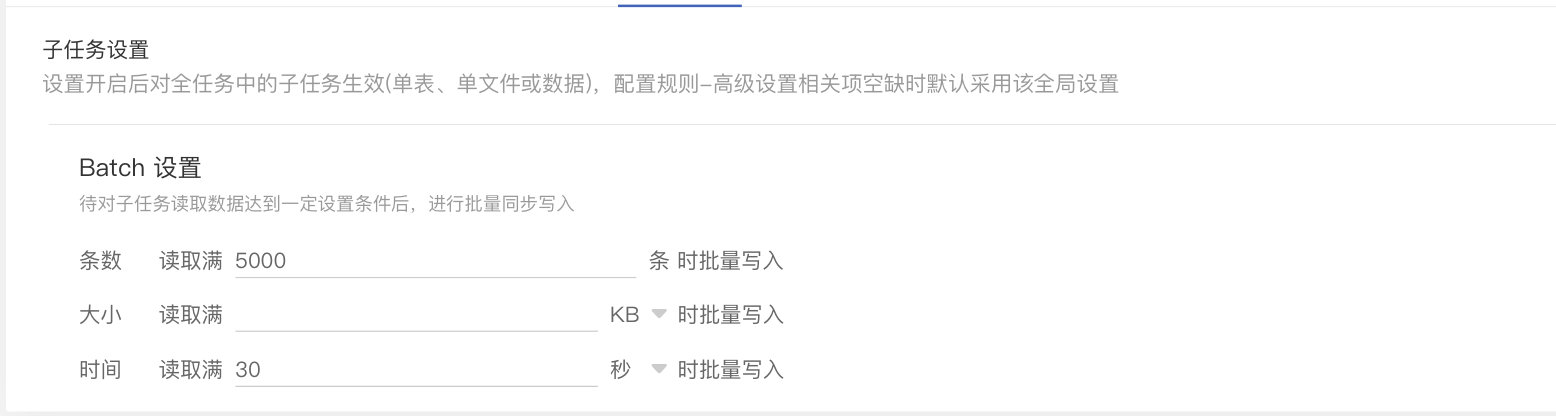

高级设置包含了「子任务设置」、「数据源变化设置」、写入数据事务一致性。

「子任务设置」

* batch条数、大小和时间代表一次性批量写入表的数据,三者满足一个条件即可生效。当达到用户设置的条数、大小或者时间时,系统会进行一批次地写入。对于设置数值的大小也应根据实际内存容量进行调整,因为当设置的值特别大时,会对内存空间造成一定的影响,如果没有开启动态限速,则读取数据会越来越多对于内存空间也占据越来越大,如果目的地无法及时消费的话,有可能造成数据丢失。

* 支持用户设置batch大小来进行批量任务的写入,开启后对全任务中的子任务生效(单表、单文件或数据),配置规则—高级设置相关项空缺时默认采用该全局设置

* batch设置

* 待对子任务读取数据达到一定设置条件后,进行批量同步写入。

* 条数类型显示“读取满____条时批量写入”,输入框数值默认为5000,允许用户修改,输入为空时提示“不能为空”。

* 大小类型显示,“读取满____KB/MB时批量写入”,KB和MB单位可在下拉栏切换,用户可选填,允许修改,可以为空。

* 时间类型显示“读取满____秒/分时批量写入”,默认为30秒,秒和分可在下拉栏切换,允许修改,输入为空时提示“不能为空”。

* 条数和时间为必填项,不允许为空

* 大小为选填项,允许为空

:-:

* 当您设置完毕后,请点击保存:

* 若任务未激活或处于暂停状态,当您启动任务后该任务会应用新的任务设置;

* 若任务正在进行中,则保存后将会自动重启该任务并应用新的配置。

<br/>

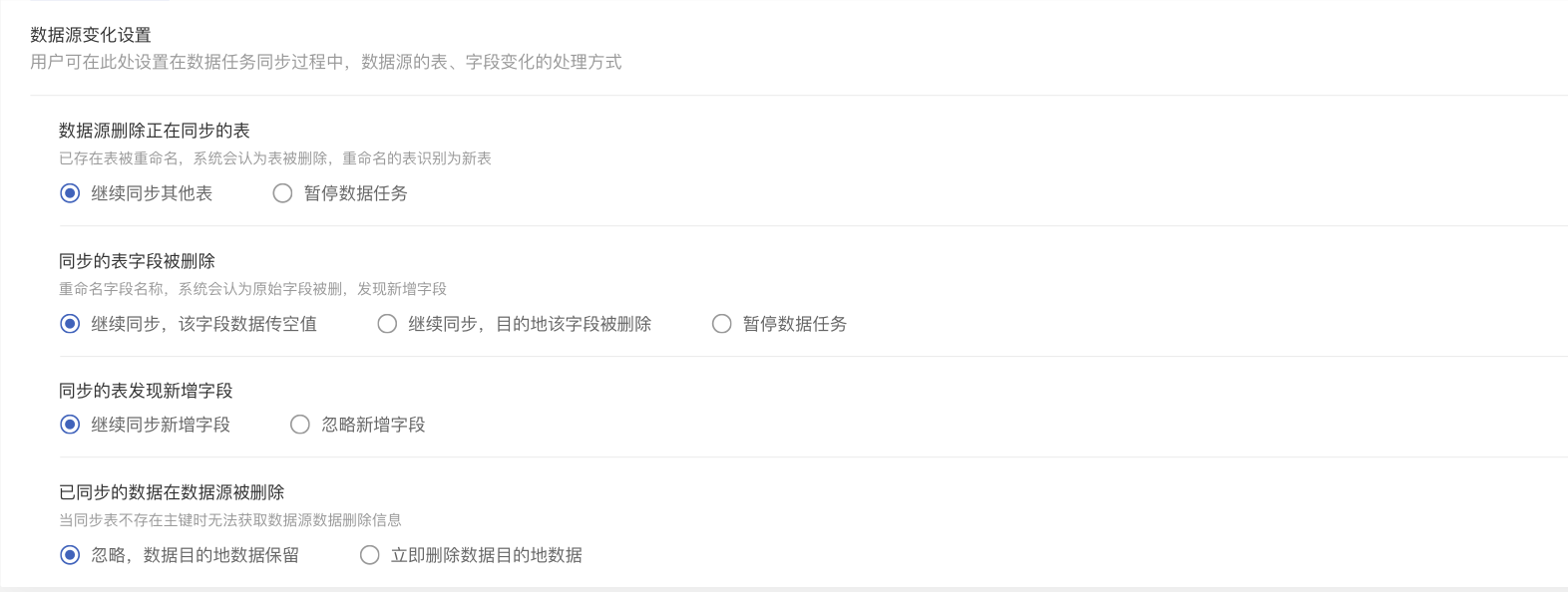

「数据源变化设置」

用户可在此处设置在数据任务同步过程中,数据源的表、字段变化的处理方式。

* 数据源删除正在同步的表

* 已存在表被重命名,系统会认为表被删除,重命名的表识别为新表。

* 选项一:继续同步其他表

* 选项二:暂停数据任务

* 同步的表字段被删除

* 重命名字段名称,系统会认为原始字段被删,发现新增字段。

* 选项一:继续同步,目的地该字段传空值

* 选项二:继续同步,目的地该字段被删除

* 选项三:暂停数据任务

* 同步的表发现新增字段

* 选项一:继续同步新增字段

* 选项二:忽略新增字段

* 已同步的数据在数据源被删除

* 当同步表不存在主键时无法获取数据源数据删除信息。

* 选项一:忽略,数据目的地数据保留

* 选项二:立即删除数据目的地数据

:-:

「数据源变化设置」根据数据源类型、目的地类型、读取范围、读取模式等的不同而有所变化。

| 数据源类型 | 目的地类型 | 读取方式 | 数据源变化支持类型 |

| --- | --- | --- | --- |

| SQL类型(mysql、oracle、sqlserver) | SQL类型/PostgreSQL/TIDB/Greenplum/Kafka/Redshift | 实时 | ①数据源删除正在同步的表 ②同步的表字段被删除 ③同步的表发现新增字段 ④已同步的数据在数据源被删除;|

| SQL类型(mysql、oracle、sqlserver) | SQL类型/PostgreSQL/TIDB/Greenplum/Kafka/Redshift | 批量读取 | ①数据源删除正在同步的表 ②同步的表字段被删除 ③同步的表发现新增字段 |

| SQL类型(mysql、oracle、sqlserver) | FTP、HDFS | 实时/批量读取 | 不支持 |

| SQL类型(mysql、oracle、sqlserver) | Hive | 实时/批量读取 |①数据源删除正在同步的表②同步的表字段被删除 (不支持继续同步,目的地该字段被删除) ③同步的表发现新增字段 (写入格式为avro时不支持) |

| SQL类型(mysql、oracle、sqlserver) | HBase|实时| ①数据源删除正在同步的表 ②同步的表字段被删除 (不支持继续同步,目的地该字段被删除) ③同步的表发现新增字段 ④已同步的数据在数据源被删除;|

| SQL类型(mysql、oracle、sqlserver) | HBase|批量读取| ①数据源删除正在同步的表 ②同步的表字段被删除 (不支持继续同步,目的地该字段被删除) ③同步的表发现新增字段|

| PostgreSQL | SQL类型/TIDB/Greenplum/Kafka/Redshift/HybridDB for PostgreSQL/Redshift| 实时 | ②同步的表字段被删除 ③同步的表发现新增字段 ④已同步的数据在数据源被删 |

| PostgreSQL | SQL类型/TIDB/Greenplum/Kafka/Redshift/HybridDB for PostgreSQL/Redshift| 批量读取| ①数据源删除正在同步的表 ②同步的表字段被删除 ③同步的表发现新增字段 |

| PostgreSQL | FTP/HDFS| 实时/批量 | 不支持 |

| PostgreSQL | Hive |实时| ②同步的表字段被删除 (不支持继续同步,目的地该字段被删除) ③同步的表发现新增字段 |

| PostgreSQL | Hive | 批量读取| ①数据源删除正在同步的表②同步的表字段被删除 (不支持继续同步,目的地该字段被删除) ③同步的表发现新增字段 (写入格式为avro时不支持) |

| PostgreSQL | HBase | 实时 | ②同步的表字段被删除 (不支持继续同步,目的地该字段被删除) ③同步的表发现新增字段 ④已同步的数据在数据源被删除; |

| PostgreSQL | HBase | 批量读取| ①数据源删除正在同步的表 ②同步的表字段被删除 (不支持继续同步,目的地该字段被删除) ③同步的表发现新增字段 |

| Hive | SQL类型/TIDB/Greenplum/Kafka/Redshift/HybridDB for PostgreSQL/Redshift/Hive | 定时读取| ③同步的表发现新增字段 |

| Hive | FTP、HDFS | 定时读取 | 不支持 |

| FTP、Kafka、API、S3、OSS | 所有目的地 | | 不支持 |

「 写入数据事务一致性」

* 用户「关闭」该选项,DataPipeline 在写入数据过程中定期标记已写入数据的进度。因系统采用定时标记,当系统出现异常重启时,可能系统无法准确定位到具体的数据位置导致目的地有重启数据产生。

* 用户「开启」该选项,DataPipeline 在每次成功执行写入操作后会记录已写入数据的进度。以此来保证系统出现异常或者rebalance的情况时,根据系统明确的标记信息来保证目的地数据的一致性。

* 如果是 JDBC 目的地,将会在目的地建立一张表进行记录;

* 如果是 FTP/HDFS 目的地,将会采取内部的二阶段提交协议,假如数据写入完成,进度记录失败,将会回滚(删除)已写入的目的地的数据;

* 如果是 Hive 目的地,将会记录进度 walog 到 hdfs,如果进度提交失败,将会回滚已写入目的地的数据;

* 如果是 Kafka 目的地,将会使用 Kafka 的事务功能,在进度被提交成功前,Kafka 内的数据无法消费,以此保证写入数据的数据一致性。

:-:

「 批量读取后,先写入到临时表,再转存到实际表」

* 支持的目的地有:MySQL、SQL Server、Oracle、TiDB、AnalyticDB for PostgreSQL、Reshift、Greenplum

* 用户「关闭」该选项,DataPipeline 会把数据直接写入到目的地真实表。

* 用户「开启」该选项,DataPipeline 会先把数据写入到临时表,当完成本批次所有数据的读写工作后,转存到实际表。

:-:

### D. 「其他设置」

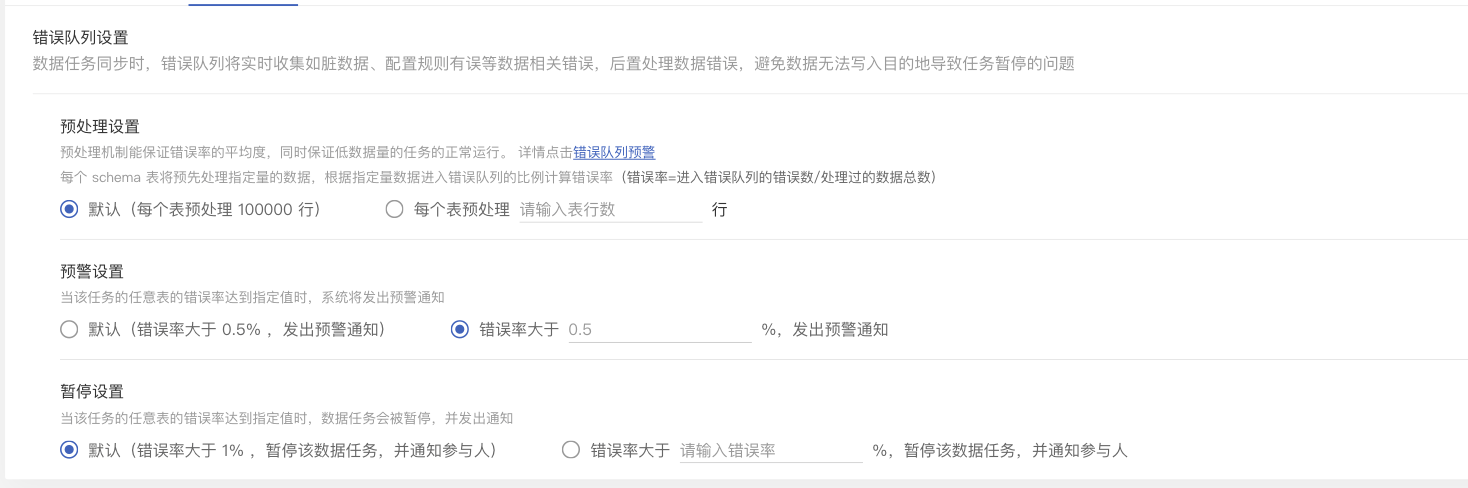

#### 「错误队列设置」

数据任务同步时,错误队列将实时收集如脏数据、配置规则有误等数据相关错误,后置处理数据错误,避免数据无法写入目的地导致任务暂停的问题。

* 支持设置预处理的数据行数(默认为100000行)

* 预处理机制能保证错误率的平均度,同时保证低数据量的任务的正常运行。

* 每个 schema 表将预先处理指定量的数据,根据指定量数据进入错误队列的比例计算错误率(错误率=指定数据量中进入错误队列的错误数/指定的数据量);该批次错误率计算后进行下一批次的计算。

* 支持用户自定义设置该任务每个表预处理的条数,直接在输入框输入即可。

* 支持设置预警的百分比(默认为0.5%)

* 当该任务的任意表的错误率达到指定值时,系统将发出预警通知;

* 支持用户自定义设置该任务触发预警通知的错误率,直接在输入框输入即可。

* 支持设置暂停数据任务的百分比(默认为1%)

* 当该任务的任意表的错误率达到指定值时,数据任务会被暂停,并发出通知;

* 支持用户自定义设置该任务触发任务暂停的错误率,直接在输入框输入即可。

:-:

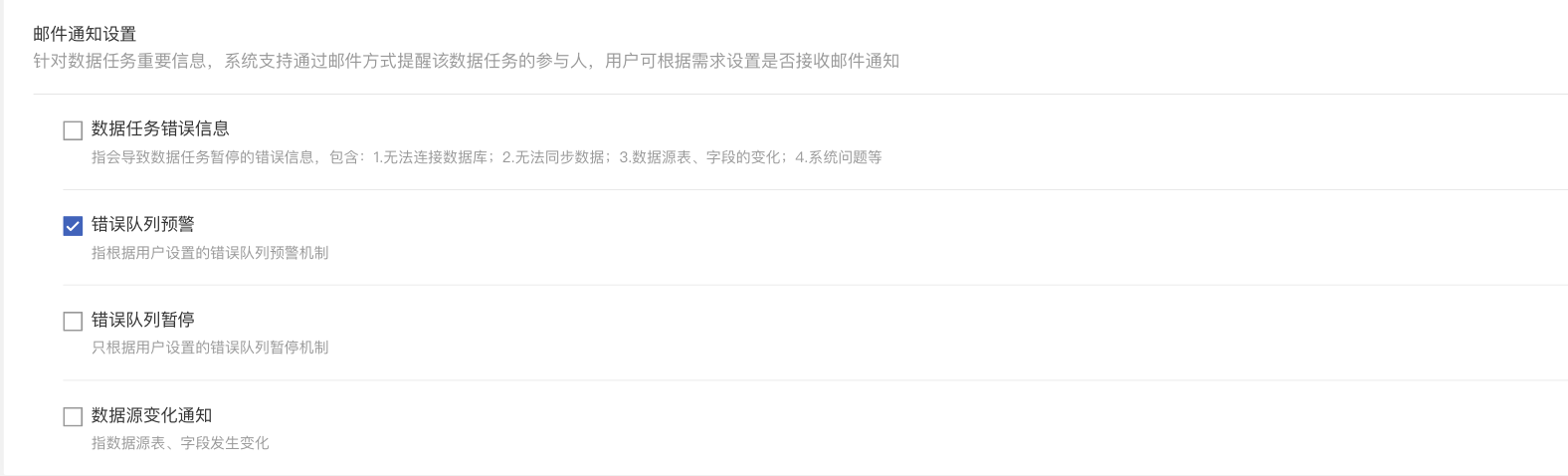

#### 「邮件通知设置」

* 支持用户设置哪些信息需要通过邮件提醒用户(默认勾选全部)

* 数据任务错误信息

* 当发生导致数据任务暂停的错误时,您将受到邮件通知,包括:

1.无法连接数据库;

2.无法同步数据;

3.系统问题等。

* 错误队列预警

* 当错误队列达到预警错误率您将收到邮件通知。

* 错误队列暂停

* 当错误队列达到暂停错误率您将收到邮件通知。

:-:

- DataPipeline产品手册

- 产品更新日志

- v2.7.0 版本介绍

- v2.6.5 版本介绍

- v2.6.0 版本介绍

- v2.5.5 版本介绍

- v2.5.0 版本介绍

- v2.4.5 版本介绍

- v2.4.1 版本介绍

- v2.4.0 版本介绍

- v2.3 版本介绍

- v2.2.5 版本介绍

- v2.2 版本介绍

- v2.1 版本介绍

- v2.0.5 版本介绍

- v2.0 版本介绍

- v2.0 以前版本介绍

- 环境和数据库的部署要求

- Mysql - BINLOG配置方法

- Oracle - LOGMINER配置方法

- SQL Server - Change Tracking配置方法

- Postgre SQL-decoderbufs配置方法

- Postgre SQL-wal2json配置方法

- 常见场景操作

- 场景一:实时同步异构数据库数据(例:MySQL到Oracle)

- 场景二:批量同步异构数据库数据(例:SQL Server到MySQL)

- 场景三:API数据同步到关系型数据库(例:API到MySQL)

- 场景四:Hive数据同步到关系型数据库(例:Hive到SQLServer)

- 场景五:关系型数据库数据同步到Hive(例:Oracle到Hive为例)

- 场景六:Kafka数据同步到关系型数据(例:Kafka到MySQL为例)

- 场景七:一对多场景介绍

- 产品入门

- 数据同步任务

- 创建数据同步

- 配置数据源&数据目的地

- 配置数据源

- 配置MySQL数据源

- 配置Oracle数据源

- 配置SQL Server数据源

- 配置PostgreSQL数据源

- 配置FTP数据源

- 配置S3数据源

- 配置API数据源

- 配置Kafka数据源

- 配置Hive数据源

- 配置阿里云 OSS数据源

- 配置腾讯云TDSQL数据源

- 配置自定义数据源

- 配置数据目的地

- 配置MySQL数据目的地

- 配置Oracle数据目的地

- 配置SQL Server数据目的地

- 配置Greenplum数据目的地

- 配置Redshift数据目的地

- 配置TIDB数据目的地

- 配置FTP数据目的地

- 配置HBase数据目的地

- 配置HDFS数据目的地

- 配置Hive数据目的地

- 配置AnalyticDB for PostgreSQL数据目的地

- 配置Kafka数据目的地

- 数据同步的任务设置

- 读取设置

- 数据源资源组设置

- 批量功能

- SQL类型数据源读取条件设置

- 分数据源读取设置

- MySQL读取设置

- Oracle读取设置

- SQLServer读取设置

- PostgreSQL读取设置

- FTP文件系统读取设置

- S3文件系统读取设置

- Hive读取设置

- Kafka读取设置

- 阿里云OSS读取设置

- API读取设置

- 腾讯云TDSQL读取设置

- Hive数据源读取分区设置

- 其他设置

- 错误队列设置

- 邮件通知设置

- 任务分组设置

- 写入设置

- 批量功能

- 设置清洗脚本

- 数据目的地资源组设置

- 数据目的地设置

- 子任务设置

- 数据源变化设置

- 写入端数据一致性

- 批量读取后,先写入到临时表,再转存到实际表

- 高级设置

- 子任务设置

- Hive分区设置

- Column family 设置

- 数据同步任务管理

- 数据任务监控

- 重要任务

- 故障任务

- 非激活状态

- 性能关注

- 数据任务分组

- 管理数据同步

- 复制功能

- 回滚功能

- 重新同步功能

- 错误队列

- 消息列表

- 文件同步任务

- 创建文件同步

- 配置文件源

- 配置S3文件源

- 配置FTP文件源

- 配置文件目的地

- 配置HDFS文件目的地

- 文件同步的任务设置

- 任务流

- 核心功能介绍

- 新建任务流

- 配置核心组件

- 配置开始任务组件

- 配置数据任务组件

- 配置远程命令执行组件

- 配置延时器组件

- 配置权限设置

- 激活任务流

- 元数据管理

- 查看总览

- 搜索页

- 详情页

- 系统设置

- 数据任务

- 元数据管理

- 用户管理

- 常见问题

- 部署要求

- Docker安装的集群部署方式?

- DataPipeline的并发任务是线程还是进程?

- 分布式架构指的是什么样的框架?

- 生产环境配置推荐及回答?

- DataPipeline的服务是统一管理还是私有化部署?若是私有化部署若要升级怎么操作?

- DataPipeline的Kafka如果与客户目前使用的Kafka版本不一样,是否需要适配?

- 请说明产品的HA和容灾方案 ?

- DataPipeline有多少独立的服务?各容器的作用是什么?

- 在从节点上装mysql,对单表导入1000万数据对任务有影响吗?

- 数据传输

- 数据源/数据目的地

- 基本要求

- 数据源或目的地可以重复使用吗?

- 数据源多个表是否可以写到目的地一张表?

- 数据源或目的地连接失败怎么办?

- 数据源

- MySQL

- DataPieline如何应对Mysql数据库表和字段名称大小写不敏感问题?

- DataPipeline Mysql数据源的实时处理模式下,暂时无法读取哪些字段类型?

- Mysql数据源实时处理模式下,暂不支持那些语句操作的同步?

- Oracle

- Oracle实时模式为LogMiner时,为什么还需要设置读取频率?

- SQL Server

- SQL Server数据源读取方式选择Change Tracking时需要注意什么?

- SQL Server实时模式为Change Tracking时,为什么还需要设置读取频率?

- PostgreSQL

- Hive

- Hive数据源支持哪些文件格式?

- Kafka

- FTP文件系统

- FTP数据源CSV静态表结构时,用户为什么需要确认首行是否为字段名称?

- FTP数据源静态表结构和动态表结构的区别是什么?

- FTP源的文件在不断写入的情况下,DataPipeline的读取与写入的模式是怎样的?

- FTP数据源支持哪些编码方式?

- S3文件系统

- 阿里云OSS文件系统

- API

- 腾讯云TDSQL

- 数据目的地

- MySQL目的地常见问题

- 时区问题需要注意什么?

- SQL Server目的地常见问题

- 行级的物理删除,使用Change Tracking的方式,是否获取的到?DataPipeline会如何处理这类的数据?

- 数据源实时模式是否可以同步视图?

- Oracle目的地常见问题

- TiDB目的地常见问题

- 目的地TIDB同步表时,需要注意什么?

- Redshift目的地常见问题

- Redshift 并发数设置是50,DataPipeline对100个表并发插入的方案?对Redshift 性能的影响?DataPipeline对大数据量并发插入Redshift 的处理方式?

- Hive目的地常见问题

- 如何避免Hive目的地出现小文件问题?

- DataPipeline同步数据到Hive目的地表时,数据源发生变化会怎么样?

- 我们目前对已做好Hive分区逻辑的目的地,是不是不支持继续往里写?只能写新表?

- 配置Hive目的地是需要注意哪些?

- Hive目的地时字段转换需要注意哪些问题?

- GreenPlum目的地常见问题

- Kafka目的地常见问题

- kafka目的地支持设置新的分区吗?

- 多个表结构不一致的表,可以同步至kafka的同一个topic吗?

- HDFS目的地常见问题

- FTP文件系统目的地常见问题

- 目的地FTP时,我们现在是按什么逻辑创建文件的?

- AnalyticDB for PostgreSQL目的地常见问题

- Hbase目的地常见问题

- 目的地常见问题

- 各个数据目的地的写入方式分别是采用什么形式?

- DataPipeline支持的数据库的目标端的连接方式是什么?

- DataPipeline支持的目标端冲突数据处理机制是什么?

- 任务设置

- 读取模式相关问题

- 任务设置中读取频率的实现原理是什么样的?

- 采用实时同步的情况,新建同步任务时,源端的数据表有大量的存量数据,如何通过产品实现数据同步的一致性的?

- 定时批量清目标表数据的逻辑是什么样的?

- 数据源端基于日志的实时模式,是源库推送还是我们做捕获?

- 关系型数据如MySQL,如果出现大量的数据修改,BinLog日志如何抓取,如何实现及时的消费?

- 读取与写入的速率限制是按照任务还是按照表?

- 我们的无侵入性是如何实现的?是完全无侵入性,还是侵入性很小?是否无侵入性就意味着源端服务器没有访问请求的压力,那目的端写入是否还存在压力?

- 动态限速的策略是什么?

- 读写一致性的逻辑是什么?

- v2.6版本增量的逻辑如何实现?

- 重新同步策略问题

- 如果任务激活后进行重新同步,目的地数据会清空吗?

- 读取设置

- 如何设置数据读取条件where语句?有哪些注意事项?

- 用户选择实时模式时,选表时发现有一些表置灰不能同步要想同步这些表该怎么办?

- 同步完成后暂停,取消表后又新加入此表,DataPipeline对于此表的处理策略是什么样的?

- 写入设置

- 表和字段问题

- 目的地表名称和字段名称最长字符长度有什么特定限制吗?以及表名称和字段名称的输入规则要求是什么?

- 同步数据到异构数据库,字段类型会有变化吗?

- 表结构中的精度和标度是什么意思?

- DataPipeline所支持的不同数据类型有哪些?kafka schema的数据类型和不同库间的数据库转换规则?

- 数据源端支持哪些字符集类型?

- Hive作为目的地表需要注意什么?

- Hive作为数据源且格式为parquet时需要注意什么?

- 如何新增一个字段?

- 主键相关问题

- 无主键的表的同步逻辑是怎样的?

- 选择增量识别为主键,如何保证源端和目标的数据一致性呢,如果该记录有修改,系统是怎么处理的?

- 数据目的地ODS有大量无主键表,同步时DataPipeline是如何处理的?

- 表结构变化问题

- 任务激活前后,数据源变化表结构变化有什么不同?

- 当数据源表结构更新时DataPipeline是如何处理的?

- 如果目的地端已经存在了数据库表,但表结构不相同,我们能否将数据写入到该表?

- DataPipeline是否支持将不同的数据表(在不同的数据库中,但是表结构一致,同时有主键和唯一性识别的字段),导入同一个目的端表?

- 管理数据同步

- 基本概念

- 错误通知是什么?

- 错误队列是什么?

- 哪些数据错误会进入错误队列?

- 请简述产品支持的目标端冲突数据处理机制?

- 错误队列里的原始数据是指源端读取的原始数据还是说经过清洗规则后的数据?

- 激活任务后,有哪些参数可以修改?

- 同步状态

- 部分表已读取已写入等都为0,但完成进度为100%?

- 任务详情页中的数据读写量具体含义是?为什么有时候还会减少?

- 如何去查看FTP源和FTP文件中的文件有没有同步完成?

- 数据任务激活后是不允许修改任何设置吗?

- 激活任务后,数据百分比为什么会往回条,如:从99% 跳到30%

- 同步逻辑

- 自动重启逻辑是怎样的?

- 目前数据同步的暂停重启策略是什么样的?暂停和重启后是如何读取和写入数据的?

- 目前进行数据任务的时候,读取速率远大于写入速率,其中,已读取且还未写入的数据会暂时存储在Kafka上,但是由于Kafka存储空间有限,超出后容易造成数据的丢失,这怎么办?

- 如果一条数据多次、频繁变化,在DataPipeline产品侧如何保证数据的并行和保序是如何保证的?

- 用户导入数据后,hdfs认证机制,数据哪些用户可以使用,用户数据安全如何确保?

- 请简述目标端性能可管理性(可提供的性能监控、分析、调优手段等)

- DataPipeline是否支持远程抽取数据?

- 如果一条数据多次、频繁变化,在DataPipeline产品侧如何保证数据的并行和保序是如何保证的?

- 产品到期问题

- 产品使用期限到期所有任务都会被暂停任务,那么如何提前获知产品使用期限是否到期以避免任务被暂停?

- 实际场景中,目的地服务器每周可能会有aws升级,需要暂停服务器,DataPipeline有没有对应的方案能够满足?

- 任务报错

- redis连接异常任务暂停了怎么办?

- 文件传输

- FTP文件源同步整个文件时是如何同步的?

- 任务流

- 如何使用远程命令执行脚本来调取另外一个任务流?

- 任务流开启状态下,任务此时关闭掉任务流,正在同步的组件任务的处理逻辑是什么样的?

- 任务流中上游组件有多个组件任务时,上游任务全部完成才能开启下游任务吗?

- 任务既连了开始键,又配置了依赖,执行逻辑会是什么样的?

- 任务流中新建任务为何只有读取方式为增量识别字段,没有binlog?

- 任务监控

- 什么样的实时传输任务会在性能关注中显示?